未経験者必読!データアナリストになる方法を解説

最終更新日:2020-4-26

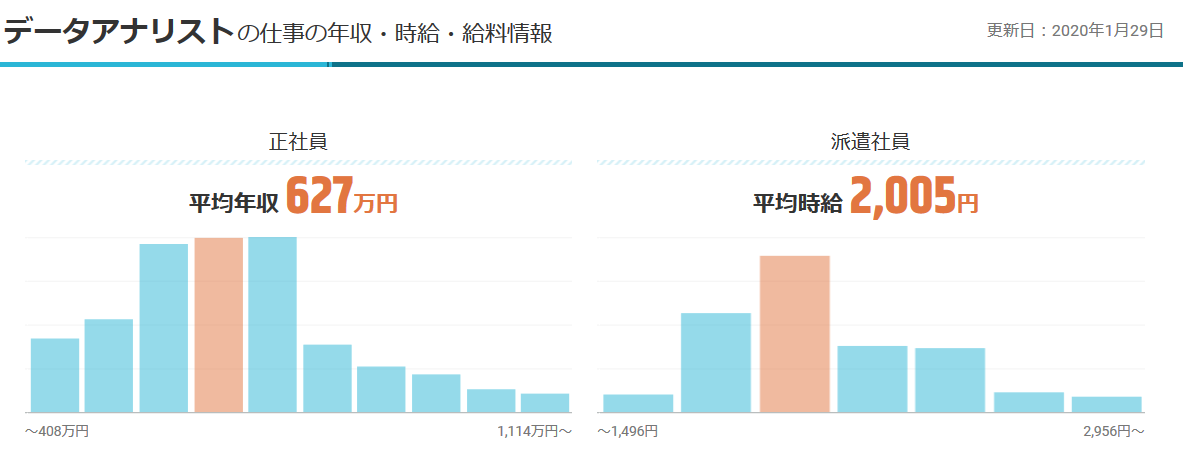

ビッグデータの発展とともに、データ収集、データ保存とセキュリティ技術が成熟し、多くの企業がデータの利活用に取り組みはじめます。企業が抱えている問題の一つとして、データ分析の人材「データアナリスト」の不足があります。この背景において、データアナリストになりたいと考える人も増えています。ところが、「データアナリストになるにはどうすればいいのか」に戸惑う方は多いでしょう。ここは、データアナリストの仕事内容、将来性と必要なスキルを紹介します。最後でデータアナリストにおすすめの学習リソースを挙げるので、ぜひ参考にしてください。

目次

1.データアナリストとは

データアナリストとは、一言いえばデータ収集、データ処理とデータの統計分析を専門にする人を指します。彼らは特定の課題に対して、なぜ起こったのかという仮説を立て、大量のデータの抽出、データのクロス集計や回帰分析などによって仮説を検証し、解決策を導き出します。

データアナリストは探偵のように、データの後ろに隠された法則を発見し、物事の仕組みを理解してから、現実問題を解きます。だから、データアナリストは創造的でやりがいを十分に感じる仕事といえます。

2.データアナリストの仕事内容

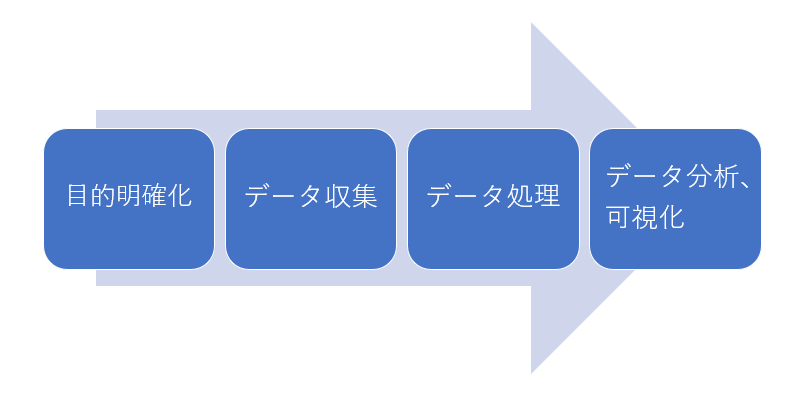

データアナリストの仕事は業界と企業によって少し違いますが、データ分析や調査を行うのが主な内容です。データアナリストとして、基本的な流れを身につければ、大きなミスを避け、仕事の効率を向上させることができます。

目的を明確化する

データアナリストの仕事がデータ解析を元に課題に対して解決案を提出するので、第一歩は目的を明確にすることです。例としては、アプリの新規ユーザが増えたものの、コンバージョン率が低下した場合、なぜこの現象が起こった原因を見つけることは目的になります。データアナリストとして、まず仮説を立て(例えば、あるチャンネルからのユーザがターゲットユーザではない)、それからデータ分析を通し、仮説が正しいかどうかを検証します。

データ収集

データ収集はデータ分析の前提です。データアナリストは仮説を立証するためのデータを集め、処理します。データは内部データと外部データに分けられます。内部データとは企業の内部に蓄積したデータのことであり、各業務システム、事業活動の記録、業務の状況や推移、顧客データなどがあります。それに対し、外部データは企業の内部からではなく、ほかの手段で取得したデータであり、スクレイピングしたWebページのデータ、官公庁や業界団体の調査データやサードパーティーのデータを含めます。また、データアナリストとして、データを収集する際、データの出所を判断し、データの信頼性を確認すべきです。

データ処理

収集したデータは内部データと外部データを問わず、そのままデータ分析に利用されることができます。データアナリストは元データをデータ処理ソフトで加工し、ユーザに理解できる業務指標に変換する必要があります。

データ分析、可視化

処理済みのデータに基づいたデータ分析と可視化はデータアナリストにとって一番重要なタスクです。データ分析はビジネス理解と強くつながります。優れたデータアナリストは会社の業務内容を理解した上でデータ分析に着手します。ビジネスに対する理解を深めると同時に、データ分析の手法とツールをマスターしなければなりません。

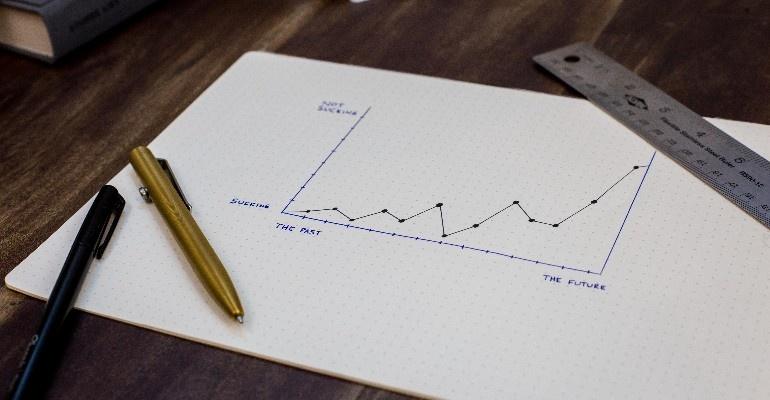

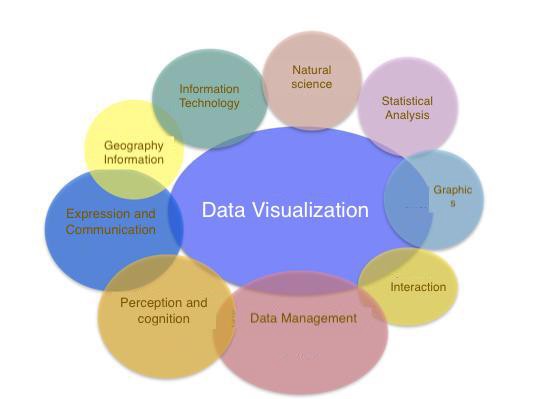

データ可視化はデータ分析の結果を表示するには最も効率的な手段です。データ分析の結果を表で提出するのが行けないというわけではないですが、人間が数値のデータを覚えるのが弱いので、グラフやチャートを介してデータの傾向や大きさを示めすのほうがいいのではないでしょうか。データ分析の方法とツールは下記の必要なスキルで紹介します。

参考:データ可視化とは

5.データアナリストに必要なスキル

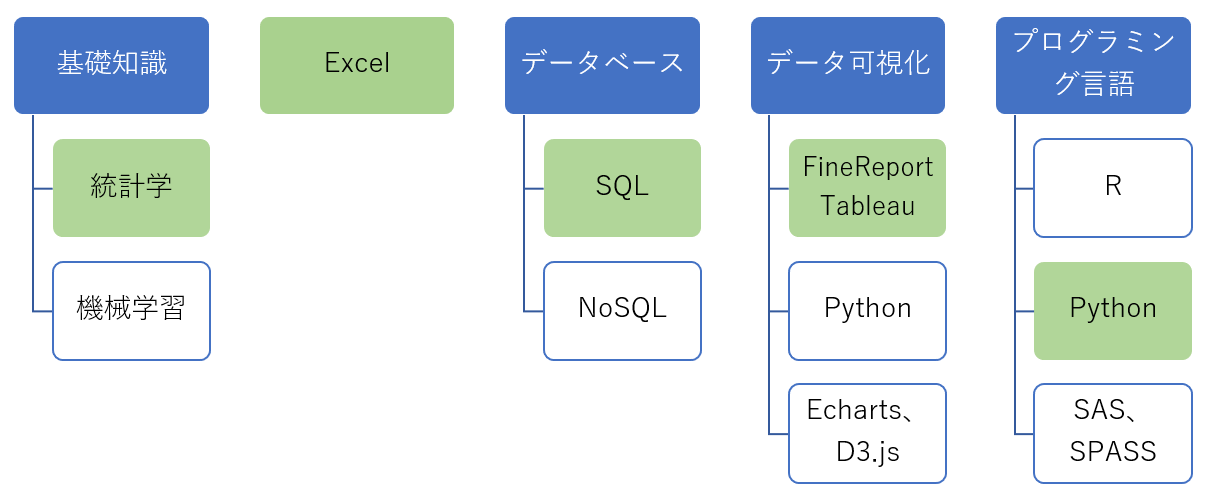

これまでの説明を通してデータアナリストの業務内容を大体理解してきているだろうと思います。次の項目では、データアナリストに必要なスキルを紹介します。

Excel

Excelは表計算ソフトとして広く利用されながら、データ分析にも重要な役割を持っています。Excelはデータの処理と計算、簡単なグラフの作成だけではなく、ピボットテーブルやVlookupなどの複雑な関数を含む高度な機能も実現できます。データアナリストはほかのデータ分析や可視化ツールを学ぶ前に、Excelを使いこなすべきです。

SQL

ウィキペディアの定義によりますと、SQL(Structured Query Language)はRDMBSにおいて、データベースの定義や操作を行うためのデータベース言語です。RDMBSが企業に一番導入されるデータベースなので、データアナリストとして、SQLをマスターしなければなりません。

SQLを独学するなら、練習しながらSQL文を覚える方法をお勧めします。SQL文の意味を大体理解した上で、実際の運用においてスキルを高めていきましょう。

データ可視化

今企業は数値を詰めず、わかりやすい可視化したレポートを利用する傾向にあるので、データ可視化もデータアナリストに必須なスキルになっています。データ可視化には、Python、Rなどのプログラミング言語やデータ可視化ツールなどがあります。

PythonとRにはチャートを描くためのライブラリがあります。Echarts、D3.jsはJavaScript製のチャートライブラリーなので、JavaScriptができなければ、データ可視化に活用できません。未経験者からデータアナリストになりたい方なら、PythonとRのような高度なプログラミングスキルはさておき、まずTableau、FineReportのようなデータ可視化ツールを勉強しましょう。

FineReportはExcelライフのUIを持ち、ドロップアンドドロップでチャートと綺麗なレポートを作成します。プログラミングスキルを持ちない人でも短時間で使えるようになります。無料体験版を提供するので、ぜひ使ってみてください。

(画像出所:FineReport)

統計学

データスクレイピング

データアナリストとして、Webから様々なデータを集める「スクレイピング」のニーズがあります。プログラミングの知識を持つ方にとっては、スクレイピングは簡単ですが、プログラミングの知識がない素人として、Pythonなどを学び、スクレイピングプログラムを構築することに時間と労力を費やすことが必要です。そこでOctoparseなどのスクレイピングツールがオススメです。

Octoparseはコーディングを必要としなく、クリックするだけでWebサイトからデータをすばやく取得できるWebスクレイピングツールです。取得したデータはExcel、HTML、CSVのような構造化フォーマットで、またはご指定のデータベースに保存されます。それに、データ抽出をよりやすくするために、OctoparseはAmazon、楽天市場、Twitterなど数多くのすぐに使えるWebスクレイピングテンプレートを提供しています。

Python/R

7.データアナリストにおすすめの学習リソース

もしデータアナリストになるための学習リソースがあったらいいなと思う方がいるでしょう。最後で独学におすすめの学習リソースを挙げます。

Excel

マイクロソフトが無料で提供しているOffice製品のヘルプセンタ―。Excelの基本的な操作からやや複雑な関数、チャートとピポットテーブルを動画で学べます。Excelの初心者におすすめします。

Excelの基本的な操作ができたら、高度な関数、マクロとVBAの勉強を進めましょう。Ofiice Proはデータアナリストの仕事でよく使われる操作をテーマ別に教えてくれるので、ぜひお役立てください。

SQL

練習問題付きの無料SQL学習サイト。スライドによるレッスンで学び、SQL文を入力してその実行結果を見ることができます。

Progateと同じく、SQLのチュートリアル問題が用意され、ブラウザだけで勉強を済ませます。そして、実務で覚えないSQL文を調べるに便利です。

統計学

初級編、基礎編、中級編に分けて統計学の知識を紹介します。基礎編から1つのレッソンに対して練習問題があります。

早稲田大学の実際の授業で使用した独習教材です。順番に学習していくと、平均から分散分析までを習得することができます。分かりやすいハンバーガー屋さんでの対話で複雑な概念を解説するので、統計学が面白いなと思わせます。

Python

データアナリストになりたいあなたには最適なPythonオンラインコースです。基礎コースは無料ですが、上級なコースは費用がかかります。実際のデータを公開するので、初心者がデータの整理と操作からPythonを学べます。

Pythonの実際応用に触れることができるチュートリアルです。ファイルの名前変更、ドキュメントの移動、データ操作用のcsvファイルの作成などの手動タスクをPythonで自動化する方法を教えます。

ちなみに、もっとデータ分析&サイエンスに関するリソースは以下の記事でご紹介します。